od体育官方网站,od体育app下载,od体育最新登录网址,od体育平台,od体育app,od体育靠谱吗,od体育,od体育官网,od体育买球,od体育世界杯,od体育注册,od体育登录,od体育入口随着人工智能(AI)系统从单纯运行模型逐步演进为编排自主的代理式工作流,基础设施的需求正在发生根本性变革。工作负载不再局限于孤立的推理任务,而是由模型、工具和服务之间的成千上万次协同交互构成。在这一全新环境中,CPU正成为AI的控制中枢——负责统筹全栈的编排调度、数据流转与系统行为调度。

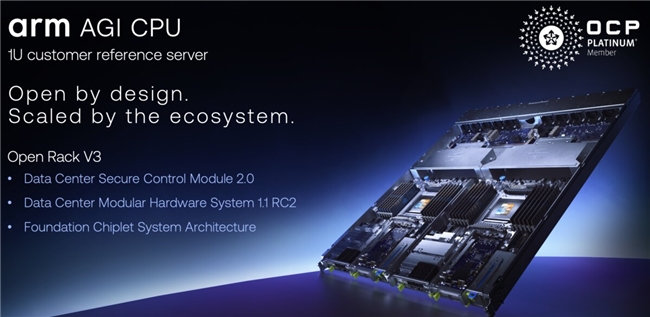

为满足这些新兴需求,Arm近期推出了ArmAGICPU——一款专为下一代AI基础设施量身打造的处理器。ArmAGICPU主打高核心扩展性、高内存带宽与系统级能效,可统筹协调CPU、GPU及其他加速器之间的复杂交互,并针对大规模部署场景下的性能、一致性与互操作性进行了优化。

与此同时,Arm正通过向开放计算项目(OpenComputeProject,OCP)持续贡献一系列技术成果,进一步践行其对开放、标准化基础设施的长期承诺。这些实际落地部署与开放生态协作的双重推进,既清晰展现了AI基础设施的演进趋势,也体现了Arm正为这一全新阶段定义核心算力底座。

Arm在AGICPU方面的工作,正与引领AI基础设施未来发展的头部超大规模云服务提供商紧密协作,其中包括主要合作伙伴及客户Meta。此次合作体现了双方在构建可扩展、开放平台方面的共同愿景,以应对日益复杂的AI工作负载需求。

AI系统面临的挑战不止于算力性能本身。系统整体效率与互操作性同样是实现工作负载规模化的关键。Arm与Meta正携手推进基于ArmAGICPU打造的新一代基础设施建设,以满足上述需求,从而实现代理式AI更高效的任务编排与落地部署。

Arm与Meta的合作凸显了行业整体发展趋势:随着超大规模云服务提供商迈向高度集成的系统架构,CPU在AI工作流管理中扮演核心角色。双方基于开放架构与系统级设计展开协作,正携手为下一代AI基础设施筑牢核心根基。

在该架构模式中,加速器负责提供模型执行所需的性能,CPU则负责工作流编排、数据流转管理及跨组件的系统行为协调。这种算力均衡架构对基于代理式AI系统至关重要,因为其性能不仅取决于计算吞吐能力,更依赖全栈层面的高效协同。

Verda的此次落地应用,反映出行业正朝着面向AI优化的集成式异构系统演进,CPU在其中正扮演核心且具有战略意义的角色。

传统的AI流程相对线性:数据输入,推理输出。而代理式系统则与之不同,它们可自主规划、推理并执行操作,往往通过跨越多个模型、服务与决策点的持续循环来完成任务。

这一转变正推动基础设施需求发生跨越式升级。加速器仍然负责执行模型工作负载并生成词元(token),而CPU则正日益承担起全系统层面的统筹协调职责。因此,CPU的需求不仅在规模上持续增长,其重要性也在不断提升。

随着这类系统持续扩展,硬件平台与系统管理的一致性变得至关重要。服务器基础系统架构(SBSA)、服务器基础可管理性规范(SBMR)等标准化架构,能够确保复杂的多智能体工作负载在多元环境中稳定运行,无需开展定制化集成。

随着AI系统复杂度不断提升,实现高效规模化扩展,不仅需要芯片技术革新,更需要生态在硬件、固件、系统设计与部署模式等层面实现协同统一。

Arm正持续贡献多项标准规范,助力OCP达成生态协同,并降低合作伙伴构建Arm架构AI基础设施的门槛。这些贡献覆盖三大核心领域:首日部署就绪、参考设计加速方案落地、打造开放的芯粒生态。

上述规范为硬件平台、系统管理与验证构建了统一基准,使操作系统与应用程序无需修改即可在各类硬件实现版本上直接运行。配套的诊断、合规测试与系统验证工具,可进一步帮助合作伙伴加快系统上线速度,同时降低部署后的运维风险。

为缩短从芯片研发到部署落地的周期,Arm正为基于ArmAGICPU的系统提供参考服务器设计。这些设计涵盖服务器硬件规范与固件开发框架,为合作伙伴提供满足量产标准的技术基础。

此类规范在对系统设计核心要素进行标准化的同时,保留了差异化定制的灵活空间,有助于简化开发流程,助力合作伙伴在各类应用场景中实现更快速、高效的部署。

该方案支持模块化系统设计,可降低集成复杂度,帮助合作伙伴更高效地开发与部署面向AI优化的芯片平台。

随着AI基础设施的持续演进,行业的成败不仅取决于性能,更取决于能否在日趋复杂的系统环境中实现高效部署、规模化扩展与生态互通。开放标准与生态协作,将是开启AI下一发展阶段的关键支撑。